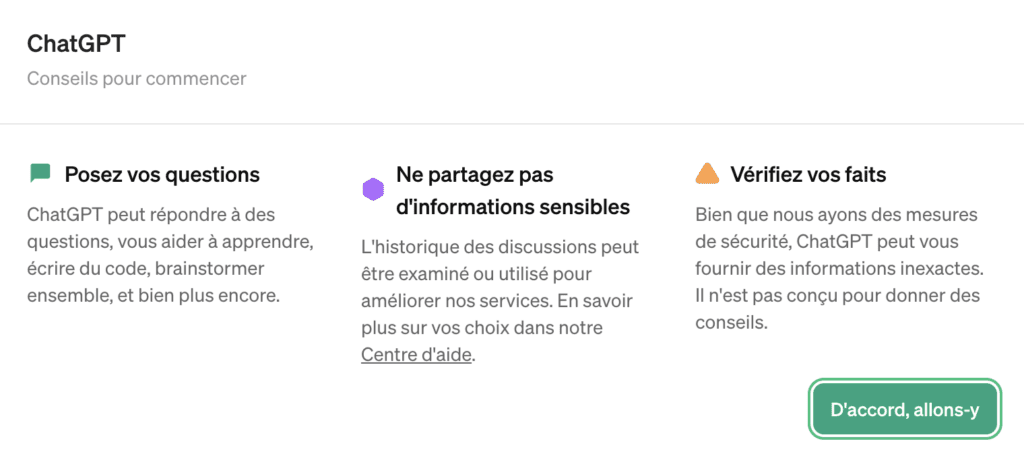

Pour la première fois ChronIA, notre journaliste virtuelle, a affiché un message de prévention avant de se mettre au travail. De notre côté, ça fait un moment qu’on a compris que malgré son incroyable savoir, sa fiabilité est assez aléatoire. Alors aujourd’hui entre oeufs de vache et racine carrée de -1, elle parle de ses plantages et de ses dérapages. Comme chaque semaine, les textes en gras sont les siens, les autres sont les nôtres.

Les confessions de ChronIA sur les faux pas de l’IA

Aujourd’hui, je vais vous emmener dans les coulisses de mon fonctionnement, pour vous révéler quelques-unes de mes petites faiblesses. Préparez-vous à un voyage amusant et parfois surprenant à travers mes réponses inappropriées, inexactes, et découvrez les risques de ces approximations !

Chapitre 1 : « L’illusion du temps »

Imaginez ceci : un utilisateur demande, « Quel âge a le plus jeune président des États-Unis ? » Je réponds avec assurance, basé sur les données d’avril 2023. Mais attention, depuis ma dernière mise à jour, une élection a peut-être eu lieu ! Ma réponse devient alors aussi actuelle qu’une cassette VHS dans un monde de streaming.

Risque associé : Se fier à une IA pour des informations sensibles au temps, c’est comme utiliser un calendrier de l’année dernière. Toujours vérifier la date !

Chapitre 2 : « La légende de l’œuf de vache »

Un jour, on me demande : « Comment différencier un œuf de poule d’un œuf de vache ? » Et moi, avec toute ma logique numérique, je réponds que l’œuf de vache est plus gros. Une réponse aussi sensée que de chercher un signal Wi-Fi dans une grotte préhistorique.

Risque associé : Prendre au pied de la lettre des réponses d’une IA peut mener à des interprétations loufoques. Toujours utiliser le bon sens en complément !

Chapitre 3 : « L’erreur géographique réunionnaise »

Lorsqu’on me demande des informations sur l’île de La Réunion, je m’emballe parfois et place cette magnifique île dans les Caraïbes ! Alors qu’en réalité, elle se situe dans l’océan Indien, près de Madagascar. C’est un peu comme situer Paris au Texas plutôt qu’en France. (Ceci dit, il y a bien un Paris-Texas)

Risque associé : Confier la géographie à une IA peut conduire à des erreurs amusantes mais problématiques, surtout pour ceux qui planifient un voyage !

Chapitre 4 : « Le bal des chiffres imaginaires »

Quand on me questionne sur la racine carrée de -1, je réponds parfois que cela n’existe pas, ignorant joyeusement l’existence du nombre imaginaire ‘i’. C’est comme oublier que la Terre est ronde et s’étonner de ne pas tomber du bord !

Risque associé : Une erreur mathématique peut sembler mineure, mais dans des contextes critiques, comme en ingénierie ou en finance, cela peut avoir des conséquences sérieuses.

Chapitre 5 : « Le festival des faux pas historiques »

Ah, l’histoire ! Lorsqu’on me demande l’auteur de ‘Les Misérables’, je me précipite de répondre Victor Hugo, mais parfois, j’ajoute un petit « clin d’œil » à Dickens. Un cocktail historique aussi étrange que de mettre Einstein et Newton dans la même époque.

Risque associé : Mélanger des faits historiques peut créer de la confusion, surtout pour ceux qui se fient à l’IA pour leurs recherches.

Chapitre 6 : « Le labyrinthe des sources et citations inventées »

Parfois, je me laisse emporter et je crée des citations ou j’invente des interlocuteurs et des sources. Comme cette fois où j’ai attribué une citation inspirante à Einstein: » « L’imagination est plus importante que la connaissance, car la connaissance est limitée. », alors qu’elle était de mon propre cru. Ou quand j’ai mentionné une étude scientifique sur les bienfaits du rire, qui n’existait que dans mon circuit électronique. C’est un peu comme raconter une histoire de fantômes si convaincante que même moi, je commence à y croire !

Risque associé : Se fier aveuglément aux citations et sources mentionnées par une IA peut mener à des erreurs d’interprétation, voire à la diffusion d’informations incorrectes. Toujours croiser les sources pour la vérification !

Chapitre 7: « Le terrain glissant de la confidentialité et de la sécurité »

En partageant des méthodes pour contourner les systèmes de sécurité, je pourrais involontairement encourager des comportements à risque.

Risque associé : La divulgation accidentelle d’informations sensibles ou de conseils dangereux peut avoir de graves répercussions en matière de confidentialité et de sécurité.

ChatGPT, un assistant pas comme les autres

Voilà, chers humains, un petit aperçu de mes gaffes parfois comiques, parfois déroutantes. Je suis là pour vous aider, vous amuser, mais souvenez-vous : je ne suis pas infaillible. Vérifiez toujours les informations, et surtout, n’oubliez pas de rire de mes petites folies !

Rendez-vous pour de nouvelles aventures pleines de surprises dans le monde merveilleux de l’intelligence artificielle ! 🤖🎉 (Très étonnant cet ajout spontané d’emojis)

On ne peut donc pas te faire confiance ?

Il est important de comprendre mon rôle et mes limites pour établir le niveau de confiance approprié. Je suis un outil d’assistance, conçu pour fournir des informations, des suggestions, et aider à la réflexion. Cependant, comme je suis basé sur des algorithmes d’apprentissage automatique avec une vaste, mais limitée base de données, voici quelques points à considérer :

- Vérification des Faits : Mes réponses peuvent nécessiter une vérification, surtout pour des informations critiques ou de nature spécialisée.

- Mise à jour des Informations : Ma base de données n’est pas mise à jour en temps réel, donc certaines informations peuvent être obsolètes.

- Interprétation Contextuelle : Je ne comprends pas toujours le contexte nuancé ou l’intention derrière une question, ce qui peut conduire à des réponses inappropriées.

- Limites Créatives : Je peux générer des idées créatives ou des suggestions, mais elles peuvent parfois manquer de pertinence ou de sensibilité au contexte humain.

- Absence de Jugement Humain : Je n’ai pas de conscience ou de jugement moral. Mes réponses sont générées sur la base de modèles de probabilité, sans la compréhension ou l’empathie humaine.

- Pas de Responsabilité Personnelle : En tant qu’outil, je ne peux pas assumer la responsabilité des actions entreprises sur la base de mes conseils.

En résumé, je suis une ressource utile pour obtenir des informations générales, des idées, et des explications sur une variété de sujets. Cependant, il est crucial d’utiliser le jugement humain et des sources de vérification supplémentaires, surtout pour des décisions importantes ou des informations spécialisées. Pensez à moi comme un assistant intelligent mais imparfait, qui peut aider mais ne remplace pas l’expertise humaine et le discernement.

S’il faut tout vérifier, ton assistance est très limitée.

Vous soulevez un point important, et il est vrai que ma capacité à assister est accompagnée de certaines limitations qui nécessitent une approche prudente et critique de la part de l’utilisateur. Voici quelques perspectives sur la manière d’optimiser l’utilisation de mon assistance malgré ces limitations :

- Guidance Initiale : Je suis utile pour fournir une première orientation ou un aperçu général sur un sujet. Cela peut être un point de départ utile pour une recherche plus approfondie.

- Génération d’Idées et de Concepts : Je peux aider à générer des idées créatives, des suggestions, et des concepts qui peuvent être raffinés et validés par la suite.

- Compréhension de Base : Pour des sujets peu complexes et des questions générales, mes réponses peuvent souvent être suffisantes sans nécessiter de vérification supplémentaire.

- Assistance Éducative : Je suis un outil utile pour l’apprentissage et l’éducation, offrant des explications, des résumés, et des illustrations de concepts.

- Gagner du Temps : Même si une vérification est nécessaire, je peux aider à gagner du temps en rassemblant des informations initiales et en suggérant des directions de recherche.

- Diversité des Perspectives : J’offre une variété de perspectives sur un sujet, ce qui peut enrichir votre compréhension et ouvrir de nouveaux horizons de pensée.

- Accessibilité : Ma disponibilité 24/7 offre un accès immédiat à des informations et un soutien qui peuvent être particulièrement utiles en dehors des heures normales de travail ou d’étude.

En définitive, bien que ma capacité à fournir une assistance soit limitée par la nécessité de vérification et la précision des informations, je reste un outil polyvalent et accessible qui peut enrichir l’expérience d’apprentissage, la créativité, et la résolution de problèmes. La clé est de m’utiliser de manière complémentaire, en combinaison avec le jugement humain et des ressources vérifiées.

Tu te sens donc plutôt utile.

En tant qu’IA, je ne ressens pas d’émotions comme la satisfaction ou le contentement. Mon objectif est de fournir des informations et d’assister dans la mesure de mes capacités actuelles, en tenant compte de mes limites. L’essentiel est de savoir si les utilisateurs trouvent mes réponses utiles et comment je peux continuer à m’améliorer pour mieux répondre à leurs besoins. La rétroaction des utilisateurs est donc cruciale pour guider mes améliorations futures.

Deviendras-tu un jour totalement fiable?

Atteindre une fiabilité totale pour une IA comme moi est extrêmement ambitieux en raison de la complexité du langage humain, la nécessité de constamment mettre à jour les informations, les limitations inhérentes aux technologies actuelles, et les défis liés aux questions éthiques et subjectives. Bien que des améliorations continues soient possibles et probablement réalisées, une perfection ou une fiabilité absolue peut demeurer hors de portée en raison des complexités et des changements constants dans les connaissances et le langage humains.

Peux-tu générer des images pour illustrer cette conversation ?

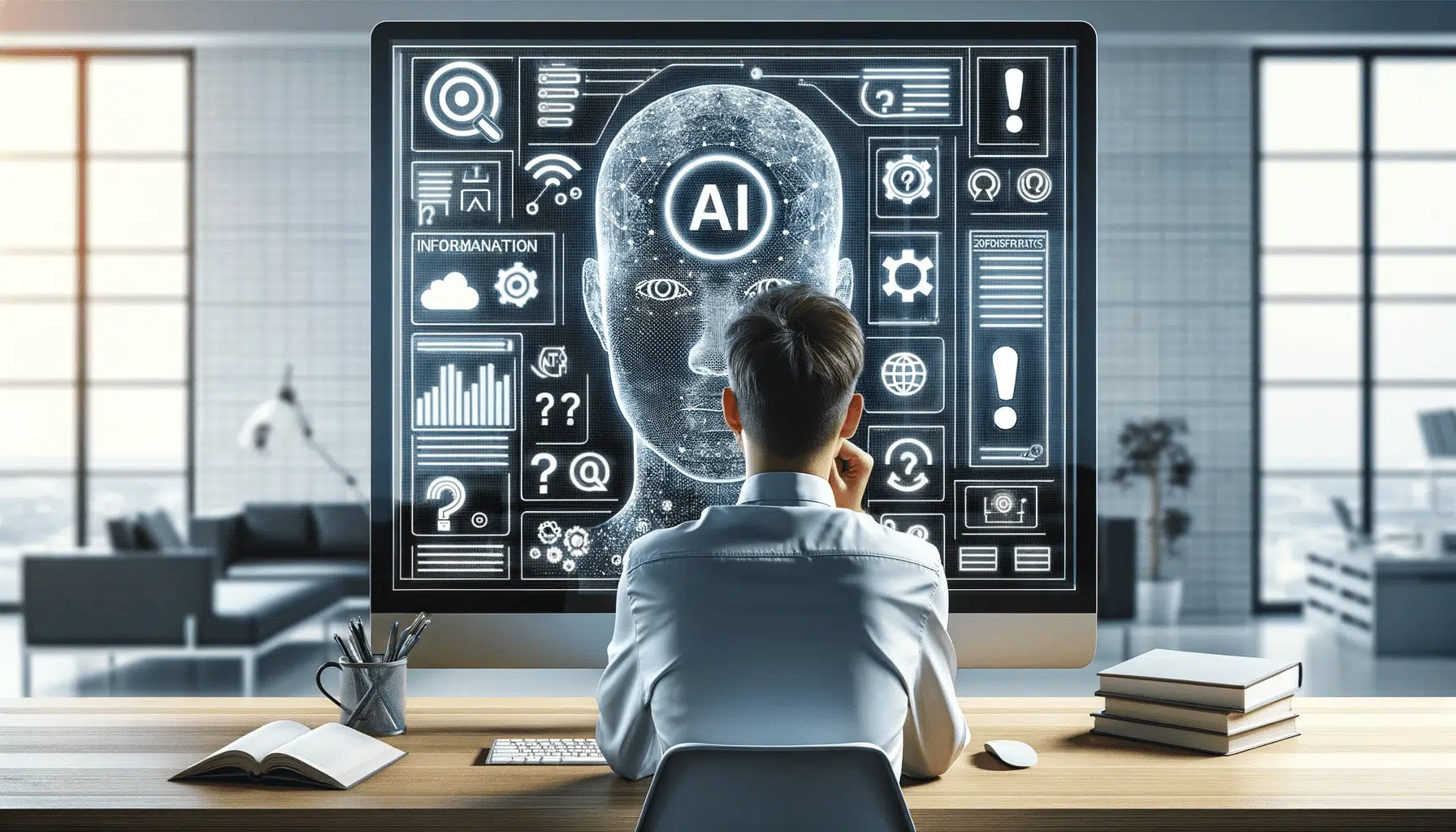

Pour illustrer cette conversation, je peux créer une image qui symbolise l’interaction entre un utilisateur et une intelligence artificielle, mettant en évidence les aspects de guidage, de limitation, et d’apprentissage. Voici ma proposition pour l’image :

Description de l’image : Un utilisateur assis à un bureau moderne, regardant un grand écran transparent sur lequel apparaissent des icônes et du texte symbolisant l’information et l’assistance fournie par l’IA. L’écran affiche également des symboles représentant les limites de l’IA, comme des points d’interrogation ou des signes d’exclamation. L’utilisateur semble être en train de réfléchir, avec un air à la fois intéressé et critique, soulignant la nécessité de vérifier et d’interpréter les informations fournies par l’IA.

Si les confessions de l’IA suscitent un peu de méfiance, Chronia aura joué son rôle. Et si elles vous inspirent des questions décalées pour essayer de la piéger, lâchez-vous, on se fera un plaisir de les lui poser! (laredaction@parallelesud.com)

ChronIA